2026-03-20

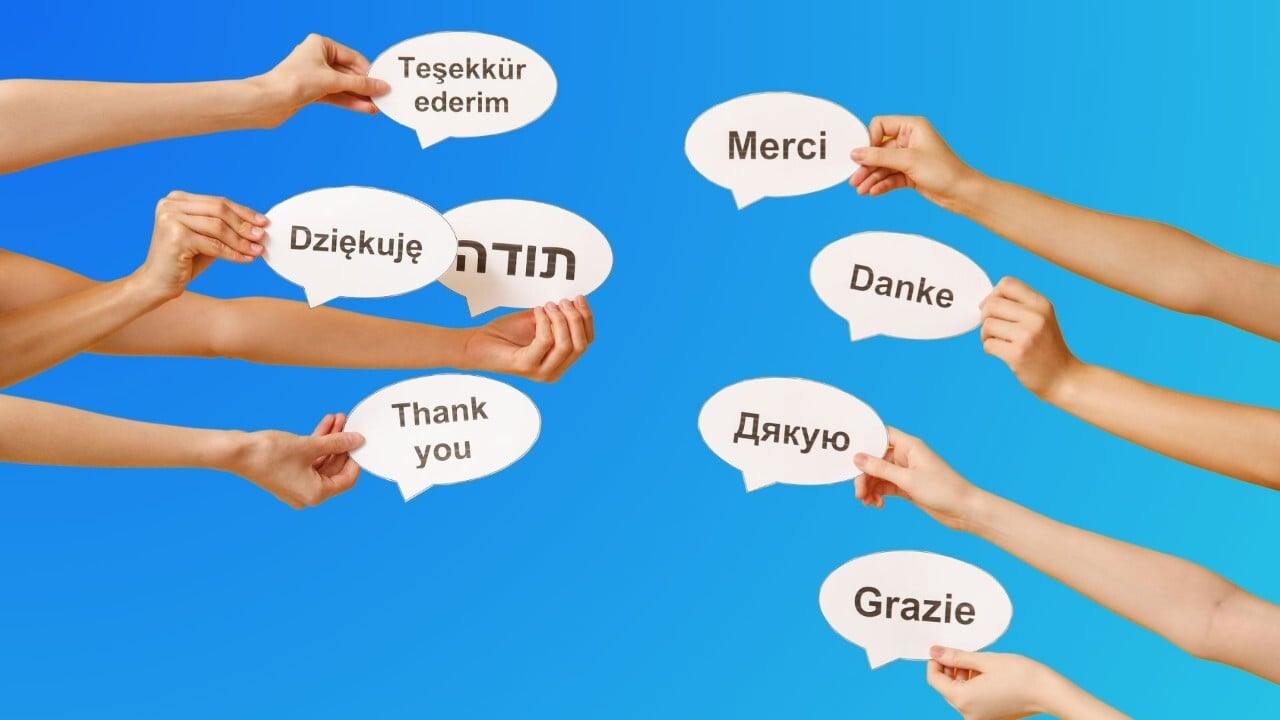

Så utvärderar du en AI-översättningsleverantör: 7 kriterier för företagsteam

Du har valt ut några AI-översättningsplattformar och alla demonstrationer ser bra ut. Testproduktionen är ren, gränssnittet är polerat och alla leverantörer hävdar att de är företagsklassade. Utmaningen är att översättningseffekten är det enklaste att optimera för en demo. Det som faktiskt behöver utvärderas är svårare att se under ett 45 minuter långt samtal.

Denna guide ger dig sju kriterier och de frågor du bör ställa. Använd dem för att göra en enhetlig utvärdering av olika leverantörer – och för att identifiera var de verkliga skillnaderna finns.

Utvärdera leverantörer av AI-översättningar utifrån sju kriterier:

-

Förvaltning och terminologikontroll

-

Efterlevnad och dataskydd

-

Kvalitetsarbetsflöde

-

Mänsklig eskaleringsväg

-

Integration och anpassat arbetsflöde

-

Spårbarhet och rapportering

-

Leverantörsstabilitet

Det är inte enbart kvaliteten på resultatet som är avgörande – det är plattformens förmåga att styra översättningen på ett enhetligt sätt i stor skala.

Därför räcker det inte med produktionskvalitet

Alla AI-översättningsverktyg kan producera bra resultat på en kurerad demofil. Det som slutar fungera på företagsnivå är allt som rör produktionen: är terminologin enhetlig mellan olika team? Flaggar plattformen segment av låg kvalitet innan de når en granskare? Om efterlevnadsproblem uppstår, kan du då spåra det tillbaka till ett specifikt översättningsbeslut?

Det är dessa frågor som avgör om en plattform kommer att hålla i ett riktigt företagsprogram – inte om exempelöversättningen låter naturlig.

De 7 kriterierna

1. Förvaltning och terminologikontroll

Fråga: Hur ser plattformen till att terminologin är enhetlig i alla team, projekt och språk – inte bara i en enda fil?

- Gemensamma termbaser och stilguider som gäller på översättningsnivå, inte som efterredigeringsförslag

- Terminologiövervakning som kan skalas upp för flera användare och samtidiga projekt

- Versionskontroll för ordlistor och godkända termuppdateringar

2. Säkerhet och efterlevnad av dataskydd

Fråga: Var behandlas uppgifterna? Är de uteslutna från modellträningen? Vad erbjuder leverantören för att stödja efterlevnad av GDPR och EU:s AI-lag?

- Uttrycklig bekräftelse på att ditt innehåll inte används för att träna en offentlig modell

- Dokumentation om efterlevnad av GDPR tillgänglig före pilotprojektet

- Företagssäkerhetsfunktioner: SSO, granskningsloggar, API-åtkomst, dedikerad miljö

- Tydlighet om var datahanteringen ska ske och vilka alternativ som finns för lagringsplats

3. Arbetsflöde och poängsättning för kvalitet

Fråga: Hur identifierar och hanterar plattformen produktion med dålig kvalitet innan den når en mänsklig granskare eller publiceras?

- Automatiserade kvalitetsbetyg på segmentnivå, inte bara aggregerade poäng

- Korrigeringsslingor som hanterar specifika kvalitetsproblem – inte bara flaggar för dem

- Konfigurerbarhet efter innehållstyp och risknivå

4. Mänsklig eskaleringsväg

Fråga: När AI-resultatet inte är tillräckligt bra, hur styr plattformen innehållet till expertgranskning – och vilka är experterna?

- Eskalering till kvalificerade lingvister

- Tydlig definition av experternas referenser och granskningskriterier

- SLA för experthantering av eskalerat innehåll

- För skyddat innehåll: obligatoriska mänskliga granskningssteg med namngiven ansvarsskyldighet

5. Integration och anpassat arbetsflöde

Fråga: Hur kopplas plattformen till dina befintliga innehållssystem – och vad krävs egentligen för integration?

- API-åtkomst för företagsabonnemang, med dokumentation och support

- Anslutningar eller integrationsvägar för CMS, PIM eller TMS

- Realistisk onboardingtidslinje

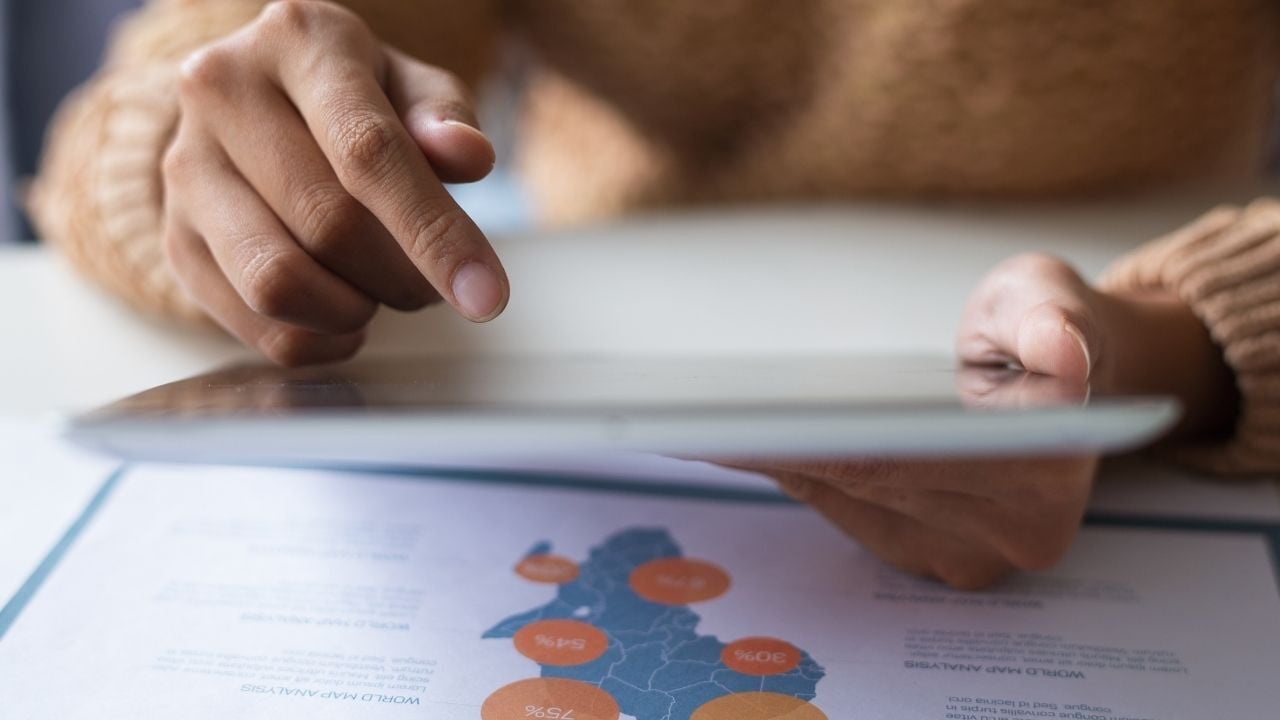

6. Spårbarhet och rapportering

Fråga: Kan du granska vad som översatts, av vem, när och med vilket kvalitetsresultat?

- Granskningsloggar på översättnings- och granskningsnivå

- Rapportering av kvalitetsresultat, volym och granskningsaktivitet per projekt eller team

- Bevisspår för inlämning av skyddat innehåll

7. Leverantörsstabilitet och tjänstekontinuitet

Fråga: Vilka garantier finns för programkontinuitet – särskilt för program med hanterad leverans?

- Definierad SLA för både plattformens drifttid och leveransen av hanterade tjänster

- Onboardingstruktur: stegvis utrullning, stöd för parallella körningar, dedikerad projektledare

- Vad händer med dina tillgångar (termbaser, stilguider) om du behöver lämna företaget?

De viktigaste lärdomarna

-

Översättningskvaliteten är lätt att demonstrera – förvaltning, spårbarhet och säkerhet är det som skiljer plattformar i företagsklass från mer generiska verktyg.

-

Be om en livedemonstration av terminologiimplementering, kvalitetsbedömning och experteskalering – inte bara exempel.

-

Datasäkerhet och efterlevnad av GDPR/EU:s AI-lag bör bekräftas skriftligen före varje pilotprojekt som inbegriper konfidentiellt innehåll.

-

Utvärdera plattformens eskaleringsväg till mänskliga experter – om det krävs en annan leverantör eller ett annat system medför detta verksamhets- och förvaltningsrisker.

-

Leverantörsstabilitet och servicekontinuitet är viktigt för företagsprogram. Fråga om SLA, onboardingtidslinje och vad som händer när det tilldelade teamet ändras.

Kandidatlista över AI-översättningsleverantörer?

Om du vill se hur Lia uppfyller dessa kriterier kan vi gå igenom detta – eller så kan du börja med Lia Go kostnadsfritt.

.jpg)