Den dolda risken med DIY AI-översättning

Fragmenterade verktyg, fragmenterad varumärkesröst

När du använder AI-verktyg oberoende av publika modeller kan du ofta förlora kontrollen över varumärkets ton och terminologi. Och när inkonsekvenser väl når olika marknader är de kostsamma att rätta till.

Om till exempel ett regionalt marknadsföringsteam snabbt översätter kampanjslogans med ett offentligt AI-verktyg kan systemet ignorera godkänd terminologi eller missa kulturella nyanser. Resultatet kan bli motstridiga taglines eller till och med oavsiktliga felöversättningar som skadar varumärkets image. Utan en gemensam ordlista eller flerspråkiga riktlinjer för varumärket blir det omöjligt att se till att alla marknader kommunicerar med samma röst eller följer företagets standarder.

Dessa inkonsekvenser är mer än stilistiska; de skapar risker för styrning och efterlevnad. Varje gång en medarbetare använder ett publikt verktyg finns det en risk att konfidentiella uppgifter eller fel som bryter mot interna riktlinjer för innehåll exponeras. Därför kräver företagsöversättning mer än bara snabbhet. Det kräver system som innehåller verktyg för att koppla samman expertis med ytterligare förbättringar som mänsklig granskning, kvalitetsmätningar och centraliserad styrning.

Det är därför det kan vara bra att använda rätt verktyg eller samarbeta med en expert för att implementera en AI-översättningsplattform. Leena ger en talande liknelse:

"Om en advokat och en lekman båda frågar ChatGPT för att hitta en juridisk referens, kommer advokaten att få bättre resultat, eftersom de vet hur de ska fråga. Detsamma gäller för översättning. Utan språklig kompetens riskerar man att tappa bort betydelsen."

Leena Peltomaa

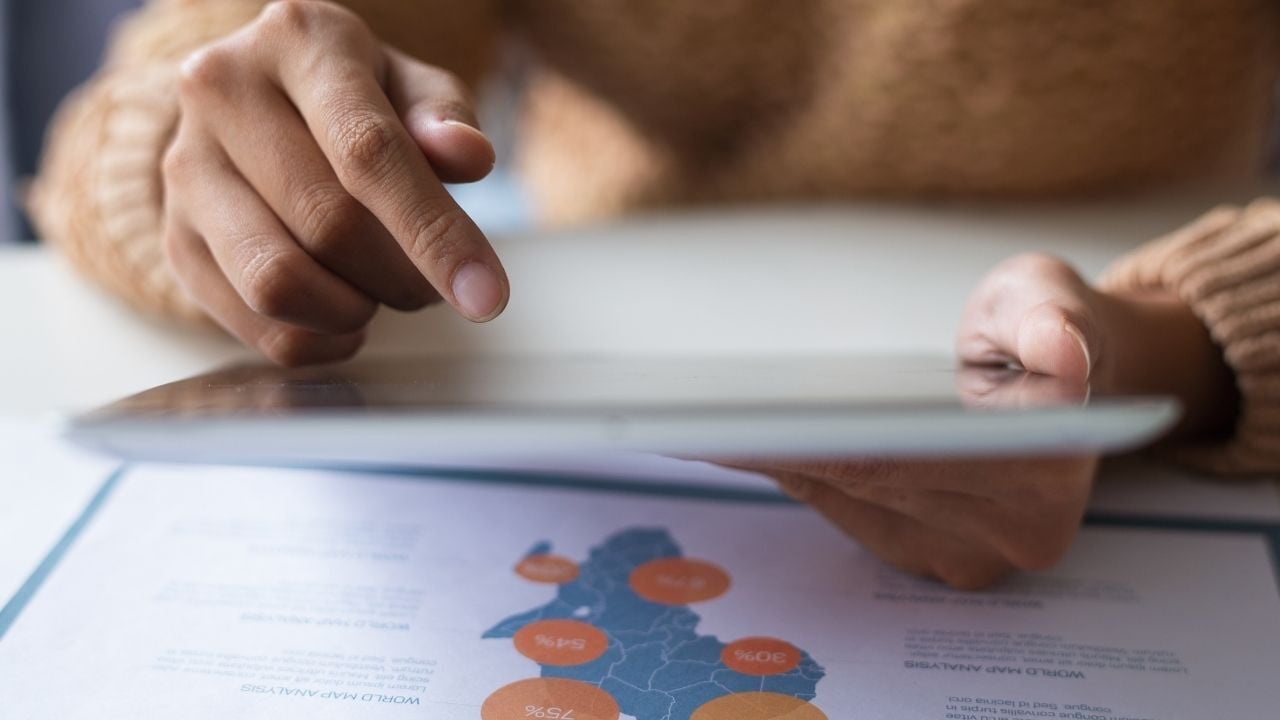

Bristen på styrning och efterlevnad

Okontrollerad användning av AI-översättningsverktyg kan också skapa allvarliga risker för styrning och reglering.

Utöver noggrannhet innebär styrning att ha insyn i och kontroll över varje steg i översättningsprocessen: från hur data samlas in och lagras, till vem som har tillgång till dem och hur resultaten granskas. Företag som är verksamma på vissa marknader behöver nu dokumenterade ansvarskedjor som visar vilket innehåll som genererats av AI, vad som granskats av människor och hur språkliga tillgångar skyddas.

Ramverk för efterlevnad som ISO 17100 och ISO 27001, tillsammans med regionala bestämmelser som EU:s AI-lag, kräver nu påvisbar transparens. Det kan handla om att veta vilka modeller som används, hur utbildningsdata hämtas och hur partiskhet eller säkerhetsrisker motverkas.

Utan ordentlig tillsyn och styrning riskerar företag inte bara felaktigheter utan även brott mot dataskyddet, missbruk av immateriella rättigheter och skadat anseende, vilket är ett allvarligt problem när man hanterar känsligt eller publikt innehåll.

.jpg)