Het verborgen risico van doe-het-zelf AI-vertaalwerk

Gefragmenteerde tools, gefragmenteerde merkstem

Als je AI-tools onafhankelijk gebruikt met openbare modellen, verlies je vaak de controle over de toon en terminologie van het merk. En als inconsistenties eenmaal verschillende markten bereiken, is het kostbaar om ze ongedaan te maken.

Als een regionaal marketingteam bijvoorbeeld snel campagneslogans vertaalt met een openbare AI-tool, kan het systeem goedgekeurde terminologie negeren of culturele nuances over het hoofd zien. Het resultaat kan tegenstrijdige taglines zijn of zelfs onbedoelde foute vertalingen die het imago van het merk schaden. Zonder gedeelde woordenlijst of meertalige merkrichtlijnen wordt het onmogelijk om ervoor te zorgen dat elke markt met dezelfde stem communiceert of voldoet aan de bedrijfsnormen.

Deze inconsistenties zijn niet alleen stilistisch; ze creëren risico's op het gebied van governance en compliance. Elke keer dat een teamlid een openbare tool gebruikt, bestaat het risico dat vertrouwelijke gegevens of fouten die interne inhoudsrichtlijnen breken, worden blootgelegd. Daarom vereist bedrijfsvertaling meer dan alleen snelheid. Het vraagt om systemen die expertise verbindende tools integreren met aanvullende verbeteringen zoals menselijke beoordeling, kwaliteitsmetingen en gecentraliseerd bestuur.

Daarom kan het helpen om de juiste tool te gebruiken of samen te werken met een expert in het implementeren van een AI-vertaalplatform. Leena biedt een veelzeggende analogie:

"Als een advocaat en een leek beiden aan ChatGPT vragen om een juridische referentie te vinden, zal de advocaat betere resultaten krijgen, omdat hij weet hoe hij moet vragen. Hetzelfde geldt voor vertalen. Zonder taalkundige expertise loop je het risico betekenis te verliezen."

Leena Peltomaa

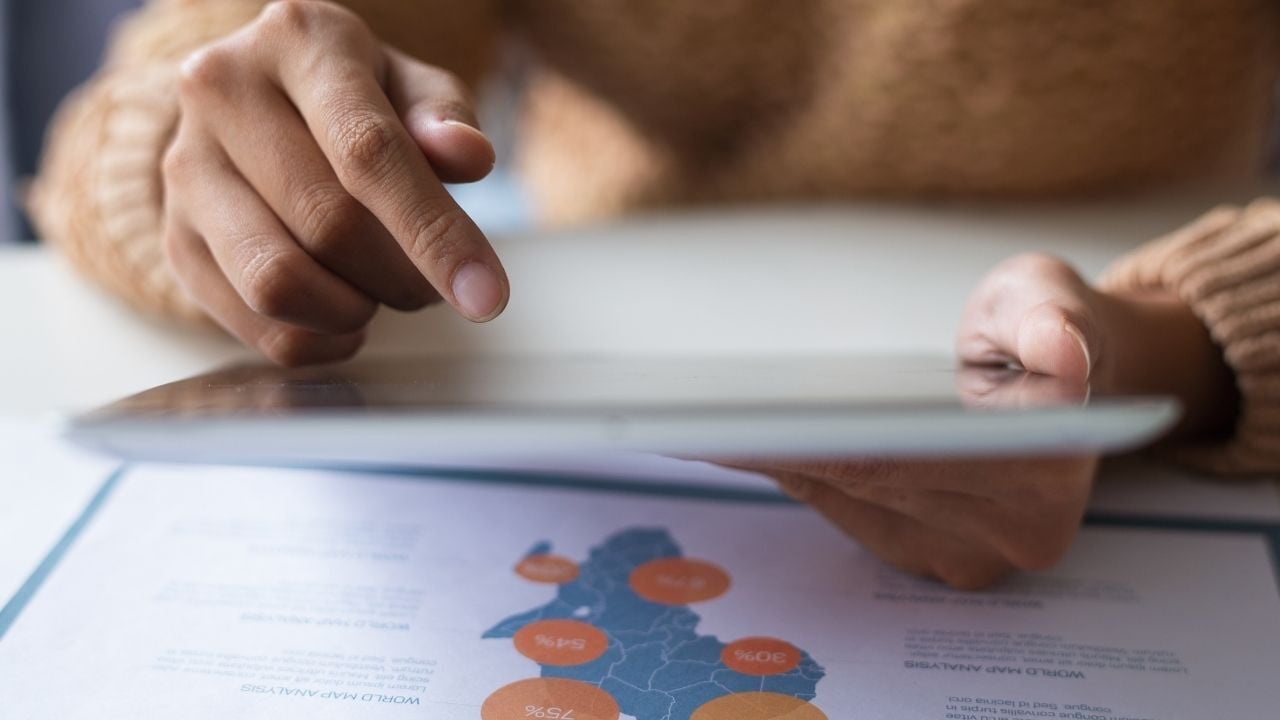

De kloof tussen bestuur en naleving

Onbeheerd gebruik van AI-vertaaltools kan ook leiden tot ernstige risico's op het gebied van bestuur en regelgeving.

Governance betekent niet alleen nauwkeurigheid, maar ook zichtbaarheid en controle over elke stap van het vertaalproces: van hoe gegevens worden verzameld en opgeslagen tot wie er toegang toe heeft en hoe resultaten worden gecontroleerd. Bedrijven die in sommige markten actief zijn, hebben nu gedocumenteerde verantwoordingsketens nodig die laten zien welke inhoud door AI is gegenereerd, wat door mensen is beoordeeld en hoe taalactiva worden beschermd.

Compliance frameworks zoals ISO 17100 en ISO 27001, samen met regionale regelgeving zoals de EU AI Act, eisen nu aantoonbare transparantie. Dit kan inhouden dat we weten welke modellen worden gebruikt, hoe trainingsgegevens worden verkregen en hoe vooringenomenheid of beveiligingsrisico's worden beperkt.

Zonder het juiste toezicht en de juiste bestuurscontroles lopen bedrijven niet alleen het risico op onnauwkeurigheden, maar ook op inbreuken op de gegevensbescherming, misbruik van intellectueel eigendom en reputatieschade, een ernstig probleem bij het omgaan met gevoelige of publieke content.

.jpg)