Tekoälykäännösten toimintaympäristön ymmärtäminen

ChatGPT, Claude, Gemini, Google Translate ja DeepL ovat tehneet kääntämisestä helpompaa kuin koskaan. Vaikka työkalut ovat tehokkaita, niiden näennäinen helppous voi olla harhaanjohtavaa erityisesti yrityskontekstissa.

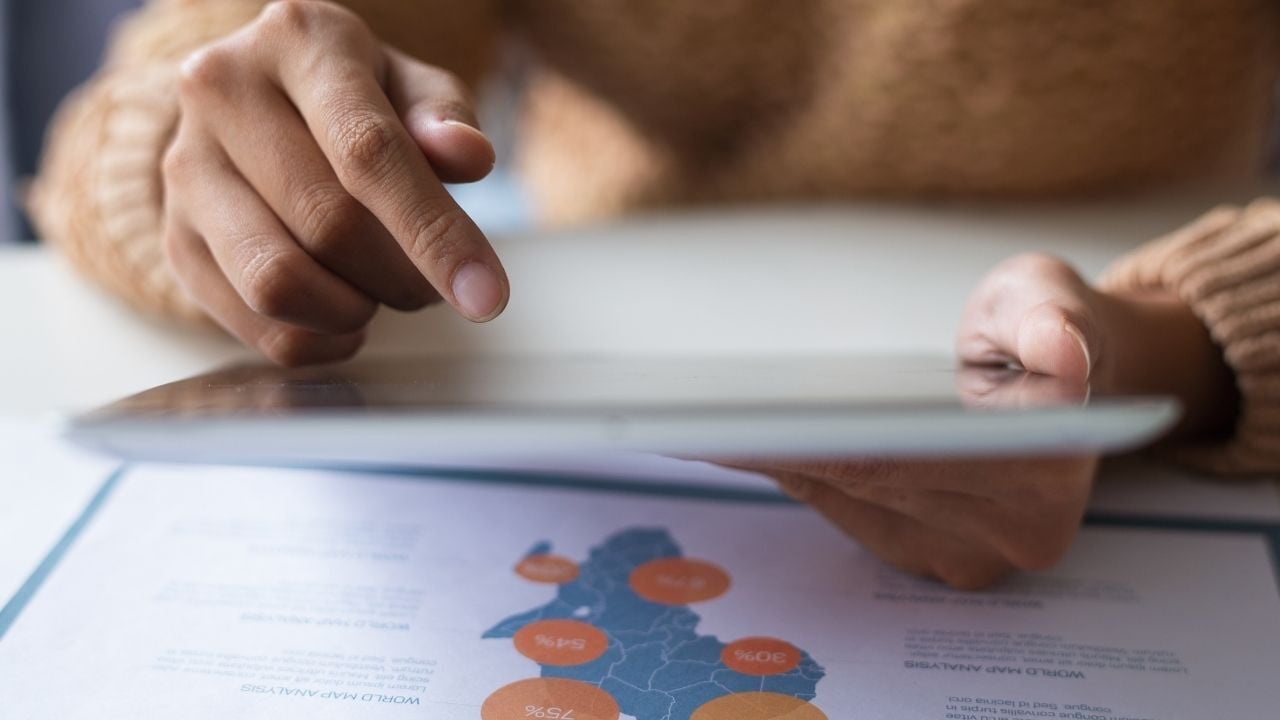

Moni markkinointi- tai tuotekehitystiimi kokeilee itsenäisiä käännöstyökaluja ja saa nopeita tuloksia. Ongelmia alkaa kuitenkin syntyä nopeasti: sävyn vaihtelevuus, puutteet hallinnassa, integraatioiden puute ja puuttuvat laadunvarmistusvaiheet.

"Kääntäminen ei ole koskaan irrallinen palvelu. Se on osa laajempaa sisällönhallinnan prosessia. Jotta merkitys säilyy yhtenäisenä, tarvitaan alusta, joka yhdistää kaikki vaiheet – ei vain työkalua, joka tekee yhden asian", sanoo Acoladin Global Solutions Manager, Leena Peltomaa.

Leenan käytännön kokemuksen avulla, jota hän on kartuttanut rakentaessaan Acoladin AI-ohjattua sisältöalustaa Liaa, tarkastelemme nyt keskeistä eroa AI-käännöstyökalujen ja AI-käännösalustojen välillä. Samalla avaamme, miten alustalähtöinen ajattelu auttaa organisaatioita rakentamaan kestäviä, tulevaisuuteen valmiita monikielisen sisällön prosesseja.

Teemat:

- Mikä erottaa AI-käännöstyökalu AI-käännösalustasta

- Itsenäisen työkalukäytön riskit

- Ihmisen rooli AI-vetoisissa työnkuluissa

- Laatu, hallinta ja vaatimustenmukaisuus laajassa mittakaavassa

- Miten alustapohjainen kääntäminen tuo tehokkuutta ja vahvistaa brändiä

.jpg)