Ansvarlig ledelse er vigtig for virksomheder, der balancerer AI-innovation med compliance. Når det implementeres korrekt, bliver det en vækstskaber, ikke en byrde.

Det nye regelsæt for AI-oversættelse

AI-oversættelse er blevet mainstream i virksomhederne. Det, der begyndte som en effektivitetsforanstaltning, er nu en strategisk mulighed, der lover at gøre det muligt for organisationer at kommunikere globalt med høj hastighed og i stor skala. Men med magt følger ansvarlighed, eller endda ansvar (som det blev formuleret i Spider-Man!).

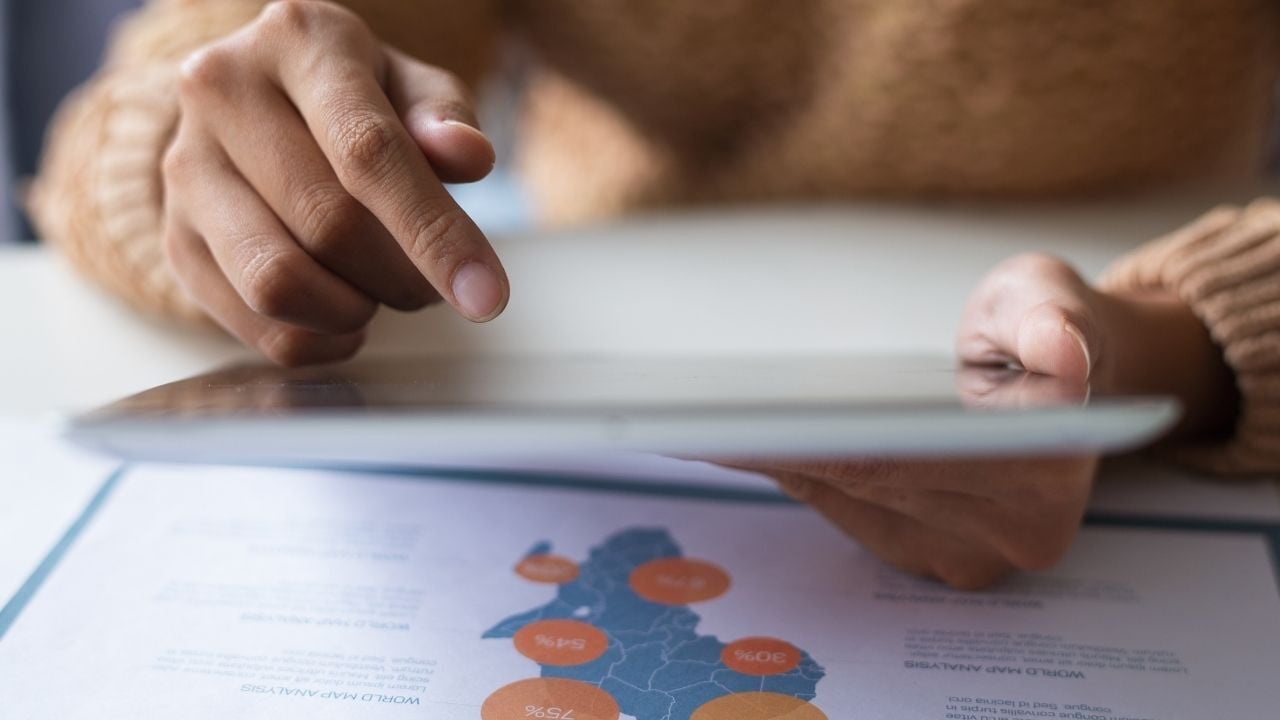

Udfordringen Balance mellem automatisering og overholdelse af regler, fortrolighed og etisk integritet. I takt med at EU's AI-lov, ISO-standarder og rammer for privatlivets fred strammer reglerne, skal virksomhederne udvikle sig fra eksperimenter til governance-first AI adoption.

Dette er den nye modenhedskurve: ikke bare hvor hurtigt AI oversætter, men hvor ansvarligt den gør det.

De vigtigste emner, vi dækker i denne artikel:

- Hvorfor styring af AI-oversættelse er en ramme for tillid

- Hvorfor nye regler betyder, at ledelse er vigtig

- Risikokategorier og afbødningsstrategier

- Opbygning af kompatible AI-oversættelsesworkflows

- Bedste praksis og rammer for ansvarlig adoption

.jpg)